Aus dem Internet-Observatorium #97

"Apple Intelligence" / OECD-Bericht KI in Deutschland / German Wunderkind

Hallo zu einer weiteren Ausgabe! Diese Woche noch nichts zu den Europawahlen, da sammle ich noch (beziehungsweise habe nicht wirklich Zeit, tiefer einzusteigen).

“Apple Intelligence”

Mit “Apple Intelligence” hat Apple auf der WWDC seinen KI-Aufschlag vorgestellt.

Was die Apple-KI nicht bietet: Autonome Agenten, also KI-getriebene Software, die selbständig Aufgaben erledigen kann (zur Diskussion siehe Ausgaben #66, #72, #77, #82). Dafür sind große Sprachmodelle (LLMs) auch noch zu unzuverlässig, gerade bei größerem Systemzugriff.

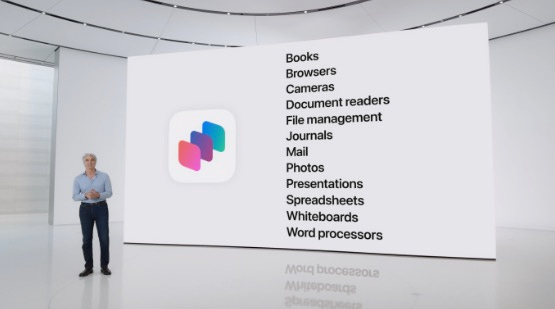

Aber immerhin ist Siri nun eine Art Kontext-Klickworker. Einerseits kann “Apple Intelligence” semantische Informationen wie Kalender-Einträge, Fotos etc. (“Entities”) aus Apps aufrufen und analysieren. Und zugleich können diese Informationen künftig mit erweiterten Intents kombiniert werden - also bestimmten Funktionen, die App-Entwickler vorher festlegen. Techcrunch nennt dieses Beispiel (übersetzt):

“Mit den Intents könnte eine Fotobearbeitungs-App wie Darkroom den Befehl “Filter anwenden” nutzen, so dass die Benutzer einfach sagen könnten: "Lege eine filmische Stimmung über das Foto, das ich gestern von Ian gemacht habe", damit die App aktiv wird. Weitere Bereiche werden mit der Zeit hinzugefügt.”

Eine intuitive Steuerung per Spracheingabe oder Kurzbefehl also.

“Mit der Zeit hinzugefügt” ist allerdings ein Schlüsselbegriff. Das Ganze ist noch in der Frühphase, “Apple Intelligence” kommt im Laufe des Jahres auf Englisch, die Internationalisierung wird erst 2025 stattfinden.

Am Anfang wird das Ganze wahrscheinlich eher wie die berühmten iOS-Shortcuts funktionieren. Mittelfristig kommt es dann darauf an, ob a) Entwickler ihre Apps für das Intent-System öffnen (und damit gewissermaßen die Nutzeroberfläche stärker an das Betriebssystem abgeben) und ob b) das Ganze wirklich gut funktioniert oder wir es mit einer weiteren “Was zur Hölle machst Du, Siri?” zu tun haben. Letzteres ist nach den Siri-Erfahrungen der vergangenen 14 Jahre nicht unwahrscheinlich.

Aber nehmen wir an, es funktioniert: Prinzipiell lässt sich daraus ein weiteres KI-Szenario ableiten. Nämlich KI als Benutzeroberfläche, nicht nur über dem Web, sondern auch über dem App-Ökosystem.

Marcel Weiß hat es im Februar so formuliert (€):

“Ganz allgemein gesprochen, stellt ein multimodales Modell, das über der grafischen Oberfläche als zusätzlicher, flexiblerer, weil plattformgetriebener Zugang liegt, eine auf mittlere Sicht massive Verschiebung der Wertschöpfung im Ökosystem der mobilen Apps dar. Und zwar weg von den Apps und hin zum Betriebssystem.

Denn damit werden die Apps, die wir uns als Bündel an Funktionen vorstellen, entbündelt. Diese Entbündelung reduziert im nächsten Schritt, wie wertvoll die einzelne App im Auge der Nutzer ist. Wenn die To-do-App nur noch ein kleines Puzzleteil statt eines umfassenden Produktivitätsprogramms ist, wird sie austauschbarer.”

Kurz: Apps werden unwichtiger, wenn sie nicht mehr direkt mit dem Nutzer “kommunizieren”, sondern nur noch vermittelt über das Betriebssystem Teil von bestimmten Prozessen sind.

Von dort ist es kein weiter Schritt zu wirklich autonomen Agenten, die sich in der gesicherten App-Umgebung bewegen, die Befehle der Nutzer umsetzen oder durch bestimmte Kontext-Informationen getriggert werden.

Weitere Gedanken zu “Apple Intelligence”

Die RAM-Bedingungen (8 GB) sorgen dafür, dass derzeit nur die iPhone 15 Pros sowie die Macs der M-Serie “Apple Intelligence” bedienen können. Das klingt wie der Versuch, hier ein Kaufargument zu schaffen, ist aber wohl Rechenkraft-Notwendigkeiten geschuldet: Ben Thompsons Berechnung zufolge verbraucht die KI “on device” etwa drei Gigabyte, die weiteren fünf sind Puffer für die regulären Anwendungen, die ja auch noch laufen.

(Die hohen Hardware-Voraussetzungen bedeuten übrigens, dass das oben beschriebene Szenario “Apps werden unsichtbarer” nur sehr graduell eintreten kann).

Den Privacy-Aspekt fand ich überzeugend, soweit ich das beurteilen kann. In den vergangenen Jahren war das meines Eindrucks nach in Sachen Marketing ein Nebenaspekt, jetzt hat man ihn durch Konzepte wie “Private Cloud” wieder nach vorne gerückt. KI und persönliche Daten, die Kombination ist heikel.

Es wäre interessant zu erfahren, wie groß das Kontext-Fenster ist, das Apple auf dem Gerät selbst erlaubt, bevor es bei Überschreitung OpenAI und weitere Modelle anwählt.

Was ich in Sachen Zeitgeist interessant finde: Den Gestus der Normalität, mit dem Apple seine KI-Funktionen ins Betriebssystem eingebaut hat. Das war trotz des Marketings kein Versprechen einer Revolution, sondern eher der Pitch für eine verblüffend erscheinende, aber am Ende vor allem ziemlich nützliche neue Komponente des Betriebssystems.

Das könnte man natürlich als Schwäche auslegen, weil Apple in Sachen KI spät dran ist (was auch die späten Rollout-Termine erklärt). Man könnte aber auch sagen: Apple geht vorerst davon aus oder hofft vielmehr darauf, dass KIs 0815-Komponenten von größeren Software-Systemen werden.

Dazu passt, dass ChatGPT “zum Plug-in geschrumpft wurde”, wie es John W. Herrman formuliert. Diesen Pragmatismus finde ich nach den vergangenen Monaten und dem immer unübersichtlicheren Hype ganz entspannend.

OECD-Bericht zu KI in Deutschland

Der von der Bundesregierung in Auftrag gegebene OECD-Bericht zur KI in Deutschland ist stellenweise lesenswert - es ist allerdings eine Menge Wohlwollen dabei. Dass die Zahl der KI-Startups in den vergangenen 15 Jahren stark gestiegen ist, verwundert zum Beispiel nicht. Und nein, Gaia-X muss nicht bekannter gemacht werden, sondern gehört verschrottet, befürchte ich. Und wenn zum Beispiel das Dateninstitut gelobt wird, dann muss es wohl eher um die Idee gehen - denn der genaue Impact lässt sich noch nicht abschätzen, weil das Institut gerade aufgebaut wird und noch ziemlich unklar ist, was man damit will und was daraus nach 2025 wird.

Aber ich schweife ab. Konzentrieren wir uns auf eeinige relevante Punkte in dem Bericht:

Die Forderung nach einer neuen KI-Strategie der Bundesregierung, deren Umsetzung dann durch eine beim Kanzleramt angesiedelte Stelle zur Koordinierung, Überprüfung und Vernetzung mit den anderen digitalrelevanten Strategien erfolgt.

Eine bessere Verfügbarkeit staatlicher Daten (Endlos-Thema), eine bessere Unterstützung von kleinen und mittelständischen Unternehmen bei der eigenen Datenaufbereitung. Klarere Leitlinien und Guidance im Bezug auf Datenschutz-Bedenken beim KI-Einsatz. Mehr Fachkräfte (obligatorisch).

Bessere Risikokapital-Bedingungen und niedrigere Hürden bei Staatsaufträgen für KI-Startups.

Insgesamt mehr staatliche Investitionen in die KI-Infrastruktur.

Damit könnte man schon arbeiten. Allerdings wäre es nicht unbedingt sinnvoll, wenn jetzt die darbende Ampel quasi im letzten Quartal ihrer Amtszeit noch eine KI-Strategie vorlegen würde.

Leopold Aschenbrenner, German Wunderkind

Vor 14 Jahren war Leopold Aschenbrenner noch Kinderkritiker bei der Berliner Morgenpost. Vor siebeneinhalb Jahren gewann er den Berliner Wettbewerb zu “Jugend forscht” mit einem Feinstaub-Analysegerät, damals war er für die Grüne Jugend aktiv. 2017 ging er offenbar in die USA, um an der Columbia University zu studieren. Dort schloss er nach eigenen Angaben mit 19 sein Bachelor-Studium in Statistik und Wirtschaft als Jahrgangsbester ab.

Danach wurde er unter anderem von Tyler Cowen unterstützt und war im Effective-Altruism-Umfeld aktiv. Seit 2023 arbeitete er im Superalignment-Team von OpenAI und gehörte zum Umfeld des späteren Altman-Gegners Ilya Sutskever. Vor zwei Monaten wurde er entlassen wegen nicht näher genanntem “Leaking”.

Inzwischen hat Aschenbrenner mit 24 (?) Jahren eine eigene Investment-Firma mit Fokus “Artificial General Intelligenz” (AGI), also quasi Superintelligenz, gegründet. Unter anderem mit Geld von den Stripe-Gründern.

Dazu hat er vor ein paar Tagen ein sehr optimistisches Prognose-Papier zu den nächsten zehn Jahren KI vorgelegt. Flankiert wurde das von einem Besuch im auch im in Techkreisen sehr einflussreichen Podcast von Dwarkesh Patel.

Aschenbrenner hält das erreichen einer AGI 2027 für “plausibel” und warnt davor, dass die Chinesen ihre AGI vor den US-Amerikanern entwickeln könnten.

Viel Stoff also. Kurzfassung: Aschenbrenner ist gerade in der Bay Area ziemlich angesagt. “Zvi Moshovitz schreibt mehrere Newsletter-Ausgaben über deine Gedanken”-angesagt.

Ich schreibe das auf, weil demnächst die ersten Aschenbrenner-Porträts in deutschen Medien auftauchen dürften. Und weil er als Figur in mir widersprüchliche Eindrücke auslöst.

Denn einerseits: Dass es so jemandem Deutschland zu eng wird, ist nachvollziehbar, aber weiterhin sehr schade (seine Kritik am deutschen Egalitarismus und der vermeintlichen europäischen Homogenität lässt sich nachhören und -lesen). Fakt ist: Selbst mit der besten Kapitalmarktunion der Welt und den besten Risikokapital-Bedingungen wird Europa in dieser Hinsicht die USA nicht imitieren können. Schon gar nicht die Westküste.

Zugleich ist dieses “Wunderkind will AGI, warnt vor China” ein bisschen viel. Weil Aschenbrenner für den Teil der KI-Szene steht, die mit Maschinenintelligenz keine Probleme lösen möchte, sondern der es um Intelligenz an sich geht.

Und mit der sinngemäßen Aussage “AGI kommt, lasst uns weitestgehend freie Bahn denn sonst kommen die Chinesen damit um die Ecke” befindet er sich in der jüngeren Tradition von Tech-Narrativen, die letztlich auf einer Mischung aus Wettbewerbskalkül, Lektüre von LessWrong.com und der Neigung zur Exponential-Projektion fußt. Und sich damit immer weiter von den eigentlich wissenschaftlichen Fundamenten der Disziplin Machine Learning entfernt und stattdessen dem üblichen Drehbuch des klassischen Techbranchen-Powerplay und Welteroberungs-Marketings entspricht.

Ich kann mir sogar vorstellen, dass Aschenbrenner von den Ideen überzeugt ist - und es gibt ja auch durchaus die Wahrscheinlichkeit>0, dass er recht behält. Max Read allerdings benennt Aschenbrenners Spiel in seinem Newsletter als schlichtes Bullshitting mit dem Zweck, sich einen Persönlichkeits-Rebrand zu verschaffen.

Zuerst nennt Read einige Beispiele für Aschenbrenners fehlende Belege und zweifelhafte Aussagen zum KI-Entwicklungspfad. Dann kommt er zur Sache (übersetzt und gefettet):

“In gewisser Weise ist das alles dummes Zeug von einem 24-Jährigen, der dringend ein Jahrzehnt mit einem normalen Job und einem normalen Leben unter normalen Menschen verbringen muss, die nicht wie er sind. Aber die Hinzufügung von China-Paranoia zu dem jetzt üblichen KI-Messianismus, den er vertritt, ist beunruhigend. Aschenbrenner ist hier eindeutig kein Experte, auch wenn er sich als solcher ausgibt - “Man muss der Kurve voraus sein, wenn es darum geht, wie AGI-gefüllt die KPCh ist”, sagt er im Dwarkesh-Podcast, nur um etwa eine Stunde später zuzugeben: “Ich bin mir wirklich nicht sicher, wie ernst China AGI im Moment nimmt” -, aber seine offensichtliche Fähigkeit, sein Publikum zu lesen, deutet darauf hin, dass es bei einem Teil der Investmentklasse im Silicon Valley einen starken Appetit auf diese Art von Überzeugungen gibt.”

Das Urteil will ich einmal so stehen lassen, ohne es mir zu eigen zu machen. Vielleicht, weil ich mir seit meiner Zeit in der Bay Area angewöhnt habe, dieses ganze Randgeschehen rund um die Spitzen des Hype-Cycles manchmal einfach als lokale Folklore zu betrachten.

Links

Niemand vertraut Windows Recall.

Adobe korrigiert Datennutzungs-Bedingungen nach Sorgen wegen KI-Trainingsdaten.

Check-Point-Sicherheitslücke: 1800 IT-Systeme deutschlandweit betroffen.

Die FCC bereitet sichere Internet-Routen vor.

Deepfake-Nacktbilder an Schulen: die nächste Warnung.

Warum es weiter so gut funktioniert, im Internet zu lügen.

Gute und schlechte Aspekte des KI-Booms.

Instagram: Rollout von Werbeanzeigen, die sich nicht abbrechen lassen?

Shitshow-Firma Humane (bekannt durch den AI Pin)

Warum Datenschutz wie Fischen ist.

Starlink im brasilianischen Regenwald.

Bundesregierung: Webex-Probleme und kein Ende.

Bis zur nächsten Ausgabe!

Johannes