Liebe Internet-Beobachtende,

vorab ein kleiner Hinweis: Ich habe testweise eine Twitter-Community zur Digitalisierung gestartet. Wer Interesse hat: Gerne dazukommen.

Thema der Woche: Ausweitung der Moderationszone?

Spotify lernt in der Kontroverse um Joe Rogan - ähnlich wie auch Substack - gerade das Problem redaktioneller Verantwortung kennen. Denn der Streaming-Dienst ist kein reiner Aggregator, sondern hat sich auch konkret “Creator” gesucht.

Im Fall von Joe Rogan - mit geschätzt bis zu 11 Millionen Downloads pro Folge der erfolgreichste Podcaster der Welt - ist der Fall klar: Spotify hat einen Exklusiv-Vertrag und ist der Herausgeber. Auch wenn Spotify-Chef Daniel Ek versucht, mit dem Begriff "Lizenznehmer-Deal" für den 100-Millionen-Dollar-Vertrag einen künstlichen Unterschied herzustellen - nämlich dass Rogan ein fertiges Produkt abliefert, in das man nicht eingreifen kann.

Das ist natürlich so, als würde ein TV-Sender sagen: Wir veröffentlichen Formate von privaten Produktionsgesellschaften, haben aber keine Kontrolle, was sie abliefern. Dass Spotify Rogan offenbar völlige inhaltliche Freiheit zugesagt hat, ist schlicht Teil des Vertrags, entlässt die Firma aber nicht von ihrer Verantwortung. Wie Ryan Broderick bereits schrieb:

“Spotify doesn’t get to just put a content warning on Rogan’s episodes and treat him like they would any other podcast because he’s not any other podcast. He’s their podcast. The Joe Rogan Experience is, in every sense that matters, a Spotify production. There might not be a Spotify rep in the room while they record, but Spotify is the only place you can hear it.”

Spotify als Ganzes ist bei Podcasts etwas komplizierter einzusortieren. Einerseits konkrete Auftragsproduktionen, andererseits Millionen mehr oder weniger blind einlaufender Podcasts: Spotify liegt mit seinem Wort- (und auch Audio-)Angebot weder völlig in der Kategorie User-Generated-Content-Plattform wie Twitter; noch lässt es sich in die Eigener-Content-Streaming-Sparte a la Netflix oder Disney Plus einsortieren. Allerdings ist das nicht neu: YouTube, TikTok, Snap, Instagram zeigen mit ihren Creator-Programmen, dass “Herausgeber” und “Plattform” in der Praxis immer stärker verschwimmen.

Spotify hat inzwischen seine Plattform-Regeln veröffentlicht. Die übrigens nicht nur für Podcasts, sondern auch für Musik gelten.

Dass die Moderationsfrage auf Audio zukommt, war bereits seit längerem erwartet worden. Im Januar 2021 schrieb ich in Ausgabe 09:

“Das Moderationsproblem verschärft sich auf verschiedenen Ebenen. Einmal durch neue Formen wie Audio (siehe Clubhouse). Vor allem aber dadurch, dass Social Media nicht nur verschiedene Subkulturen erschafft, sondern verschiedene Welten/Realitäten. Denn digital vermittelte Subkulturen sind, wie L.M. Sacaras schreibt, keine Ausdifferenzierungen nach Geschmack - sondern werden zu starken Kulturen, die “unterschiedliche Perspektiven auf die Wahrheit, moralische Fragen und Normen haben”. Aus ihnen folgt: endloser digital ausgetragener Kulturkampf.”

Dröseln wir die verschiedenen Aspekte einmal auf.

(1) Moderation über klassisches Social Media hinaus

Moderationsdebatten finden gerade in den unterschiedlichsten Zusammenhängen statt: Im Bereich Online-Gaming ist das Thema wegen Mobbing und Beleidigungen seit längerem aktuell. Im Kontext offener NFT-Marktplätze löst die Frage, ob ich NFTs verifiziere, eine Kaskade an Anschlussfragen darüber aus, wie dezentral und "unzensierbar" web3-Dienste wirklich sind.

Und rund um Metaverse/Virtual Reality hat Meta gerade die erste Moderationsfrage zu virtuellen sexuellen Übergriffen beantwortet, indem man eine technische Abstandsregel einführt.

Nun lässt sich argumentieren, dass diese Fragen alt sind - auch Ebay musste ein Anti-Betrugssysstem entwickeln, Multiplayer-Online-Games und VR sind per Definition "sozial". Podcasts als Ganzes sind "sozial", wenn man das Augenmerkt darauf legt, dass es im weitesten Sinne nutzergenerierte Inhalte sind - auch wenn eine Markt- und Plattformkonzentration begonnen hat.

Spotify hat erklärt, im Zuge der Rogan-Kontroverse etwa 20 000 weitere Podcasts gelöscht zu haben, ohne Details dazu zu nennen (Transparenz, anyone?). Weil Audio noch schwer zu moderieren ist (von Social Audio gar nicht zu reden), gehe ich von einem Keyword-Scan der Beschreibungen aus.

Podcasts machen ein interessantes Feld auf, weil sich an ihnen die Grenzen der Moderation, aber auch die mögliche Ausweitung dieser Grenze zeigen lassen.

Spotify kann natürlich selber entscheiden, welche Podcasts es einlaufen lassen möchte. Wir sind im Audio-Bereich nicht in einer Monopol-Situation, das Verteilprotokoll ist sogar dezentral angelegt: Ich kann Podcasts in jedem Podcatcher, in jedem Feedreader per RSS empfangen, auch die Google-Suche zeigt Podcasts an.

Und hier wird es interessant. Ein Szenario: Podcasts nehmen weiter an Bedeutung zu und werden verstärkt für "Hassrede", Volksverhetzung oder sonstige illegale Inhalte genutzt. Und nehmen wir an, dass das auf eine Weise geschieht, die die Verfasser nicht identifizierbar macht. Was würde passieren, wenn man das NetzDG ausweiten würde?

Sicher könnte man Spotify und auch Google zur Löschung zwingen. Aber Podcasts sind ein dezentrales System: Müsste man also versuchen, Software-Anbieter wie Stitcher oder Pocketcasts zur Löschung zu zwingen (soweit man überhaupt Zugriff hätte)? Oder die App-Stores verpflichten, nur noch Apps anzubieten, die sich einem solchen erweiterten NetzDG unterwerfen? Würde man am Ende beim vergeblichen Versuch landen, Netzsperren einzurichten?

Zugegeben, das Szenario ist etwas konstruiert. Und doch nicht weit weg von der Realität: Wir erinnern uns daran, dass die SPD-Innenministerin Nancy Faeser zwischenzeitlich Apple und Google aufforderte, Telegram aus den Stores zu nehmen (ohne Rechtsgrundlage, sondern auf Basis einer moralischen Argumentation). Australien wiederum hat im vergangenen Jahr mit seinem “Online Safety Act” gesetzliche Kontroll- und Moderationspflichten für Anbieter in folgenden Bereichen festgelegt:

Social Media

Kommunikationsanbieter (zum Beispiel Outlook, Gaming-Chatdienste)

Browser

App-Stores

Hosting-Anbieter

Cloud-Dienstleister

Eine Kommission kann den Anbietern Löschaufträge für Inhalte, Links und Apps übermitteln, die innerhalb von 24 Stunden umgesetzt werden müssen. Kurz: Der Anspruch ist die vollständige Löschung aus dem australischen Internet bis hin zum Entfernen von Diensten, die die Inhalte zugänglich machen.

Das ist eine massive Kontroll-Infrastruktur, die an verschiedensten Punkten der Internet-Architektur ansetzt. Und die bei den Anbietern massive chilling effects zur Folge haben könnte.

(2) Moderationsdruck als Diskurstaktik

An dieser Stelle sollte noch einmal daran erinnert werden: Die Kritik an Joe Rogans Inhalten und die Forderung nach Spotify-Moderation entzündeten sich nicht an Strafbarkeit. Sondern zuerst am Vorwurf des Verbreitens von Falschinformationen (direkt oder durch unkritische Haltung gegenüber Aussagen von Gästen), dann an seiner Nutzung des N-Worts.

Dabei geht es nicht unbedingt um einzelne Äußerungen, sondern quasi um Rogan als "Paket". Im Kontext Covid-19 empfahl er zum Beispiel das Anti-Parasiten-Mittel Ivermectin für die Behandlung einer Covid-Infektion. Andere Aussagen passen nicht in ein Muster: Dass er einem gesunden 21-Jährigen nicht zur Impfung raten würde, mag man für riskant, für ein Zeichen des gesunden Menschenverstands oder für unverantwortlich halten - Falschinformation verbreitet er damit nicht. Und auch der Vorwurf, Rogan sei ein Rassist, wird nicht geäußert (und würde wohl auch nicht zutreffen): Der Vorwurf lautet vielmehr, sich als Weißer mit der Verwendung des N-Worts unmöglich gemacht zu haben.

Derek Thompson bezeichnet Rogan in diesem Zusammenhang als einen DGAF-Populisten - “Don't Give A Fuck” als Markenzeichen der Egalheit, das ihn oder andere wie Bill Maher und Dave Chappelle erfolgreich macht. Und mit dem sich Spotify und Co. eine Kulturkampf-Migräne einkaufen.

Ob Migräne oder nicht: Der Druck, legale Inhalte zu moderieren oder zu löschen, ist längst verknüpft mit dem gängigen Kulturkampf. Das Gerangel um das Overton-Fenster betrifft nicht nur das "politisch Sagbare", sondern im Zusammenhang mit Covid-19 als Teilmenge auch das "faktisch/wissenschaftlich Feststellbare". Dass hier Mehrdeutigkeiten und Korrekturen eine Rolle spielen, wird oft ausgeblendet. Man erinnere sich noch die sich verändernden Aussagen zur Wirksamkeit von Masken oder Impfung (von “die Impfstoffe beenden die Pandemie” zu “der Booster schützt einige Monate vor schweren Erkrankungen”).

Statt solche Graubereiche zu akzeptieren, stehen viele gegenwärtigen Debatten - so mein Eindruck - dem Phänomen Fandom näher als einer robusten Erkenntnispraxis. Eine andere, diskursive Immunisierungsstrategie, sozusagen. Aus ihr folgt eine Rigorosität, die weit über das Motto “dein Handeln hat soziale Konsequenzen” hinausgeht (hierzu siehe auch Noah Smith).

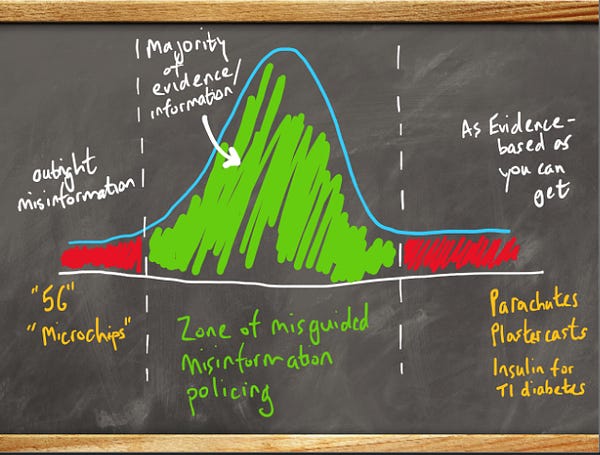

Der Wunsch, eine Handhabe gegen echte oder wahrgenommene Falschinformation zu entwickeln, ist erst einmal nachvollziehbar. Allerdings zeigt David Nuhan hier plastisch, warum die Moderation von (wissenschaftlicher) Wahrheit zu unsteten Ergebnissen führt oder sogar schädlich ist:

Und ich halte noch einen weiteren Punkt für wichtig: Das Motiv. In einem ausführlichen Artikel setzt sich Matt Yglesias mit der Frage auseinander, ob Falschinformationen wirklich zugenommen haben - oder ob es nicht vielmehr der politische Konflikt ist, der (in den USA) bis zur Allumfassenheit zugenommen hat. Dabei wendet er sich auch der Motivsuche zu und kommt zu dem Fazit:

“More generally, I think a lot of excessive worry about “misinformation” is driven by the erroneous belief that more factual information would resolve political disputes. “

Was aber hat das mit der Causa Rogan zu tun? Einmal zeigt sich, dass der kollektive Druck auf Spotify der Versuch ist, über die neuen Gatekeeper einen einheitlichen Diskursrahmen herzustellen. der in vielen Bereichen und Fragen so nicht mehr existiert und teilweise auch gar nicht existieren kann. Und dass dahinter womöglich die Vorstellung stecken könnte, in einer Welt voller rationaler Wesen würden sich viele politische Auseinandersetzungen zugunsten eines Konsens auflösen.

Dieser Tweet der eigentlich von mir geschätzten Margaret Sullivan zeigt, mit welch problematischen Argumentationsstrukturen selbst kluge Menschen dieses Ziel verfolgen:

Wenn aber dieses Bemühen scheitert, womöglich scheitern muss: Wie wahrscheinlich ist es, dass der Wunsch nach institutionellen, sprich: staatlichen Eingriffen wächst? Womit wir beim letzten Punkt wären.

(3) Staatliche Moderation von Falschinformation, Falschinformation vs. Desinformation

Das Netzwerkdurchsetzungsgesetz - und de facto auch der Digital Services Act (DSA) - haben einen beschränkten Wirkungskreis: Es geht im Kern um soziale Medien und bestimmte Lösch- und Transparenz-Pflichten für deren Betreiber. Der DSA bezieht sich absichtlich auf “illegale Inhalte”, überlässt aber die Definition von illegalem Content den Mitgliedsstaaten. In Deutschland sind Tatbestände rund um “Hate Speech” zwar erweitert worden, außer beim Bereich der Verleumdung aber ergeben sich keine Schnittstellen zu "Wahrheitsfragen" im weiteren Sinn.

Die umstrittene "Online Safety Bill", eine Art britisches NetzDG, geht da etwas weiter - allerdings im Fall eines konkreten Schadens. Die Beschreibung der britischen Regierung, was künftig strafbar ist bzw. stärker geahndet wird (Fettungen meine):

“An offence for when a person sends a communication they know to be false with the intention to cause non-trivial emotional, psychological or physical harm. (...) It covers false communications deliberately sent to inflict harm, such as hoax bomb threats, as opposed to misinformation where people are unaware what they are sending is false or genuinely believe it to be true. For example, if an individual posted on social media encouraging people to inject antiseptic to cure themselves of coronavirus, a court would have to prove that the individual knew this was not true before posting it.”

Hier wird auch ein wichtiger Unterschied zwischen Falschinformation und Desinformation gemacht. Bei Letzterer besteht eine klare Absicht. Die ist im Einzelfall mal schwieriger, mal einfacher nachzuweisen.

Im Diskursraum insgesamt dagegen ist "Desinformation" als Begriff keine Hilfe mehr. Wir erinnern uns an die Trump-Ära, als Trumpisten ständig "Fake News" riefen, die Demokraten dagegen die Wahl Trumps lieber als Resultat russischer Desinformationskampagnen brandmarkten, als sich mit der Realität der politischen Atmosphäre zuhause auseinanderzusetzen.

In der Praxis haben, das zeigt dieser ältere Poynter-Bericht, vor allem autoritäre Staaten Gesetze gegen “Desinformation” erlassen. Und zwar oft mit dem Ziel, den Publikationsrahmen für Journalisten oder Oppositionelle - speziell in Wahlkämpfen - zu begrenzen.

Mittelfristig lässt sich absehen, dass das Thema weitere Relevanz erhalten wird, sollte die bislang ausgebliebene Verbreitung synthetischer Medien ("Deep Fakes") doch noch anstehen. Auch der Bereich “Informationskrieg” könnte zu Content-Debatten führen, die wir vor ein paar Jahren noch nicht für möglich gehalten haben.

Mein Eindruck ist, dass in Teilen demokratischer Gesellschaften der Wunsch nach einer ordnenden Instanz wächst, die klare Grenzen zwischen “wahr” und “unwahr” zieht und entsprechend aussortiert. Es wäre allerdings naiv zu glauben, dass dies ohne massive negative Nebenwirkungen möglich wäre - oder das Problem nachhaltig lösen würde.

Linktipps

Brillantes Essay über Gewohnheiten, Automatisierung und gedankenlose Tätigkeiten in einer digital-vermittelten Welt. (Lesen, bevor es wieder hinter die Paywall wandert!)

Telegram: Hassmaschine, Messenger, Dissidenten-Kanal

Mein Deutschlandfunk-Hintergrund zum Thema Telegram.

The Battle for the World’s Most Powerful Cyberweapon

Wie Israel mit der Pegasus-Spyware Diplomatie betrieb.

Beware the FOMO Bullies of Technology

Über die Psychologie von web3-Begeisterung und -Skepsis.

Their Bionic Eyes Are Now Obsolete And Unsupported

Was passiert, wenn ein Hersteller bionischer (Augen-)Implantate plötzlich aufhört, sich weiter um sein Produkt zu kümmern?

Wie die Reparatur des abgetrennten Untersee-Kabels nach Tonga funktioniert. Mit vielen hilfreichen Visualisierungen.

Leben mit einer Vergangenheit, mit der wir im Stream interagieren können.

Bis zur nächsten Ausgabe!

Johannes